不知 Gemini 1.5 Pro 是否用到了这项技术。

谷歌又放大招了,发布下一代 transformer 模型 infini-transformer。

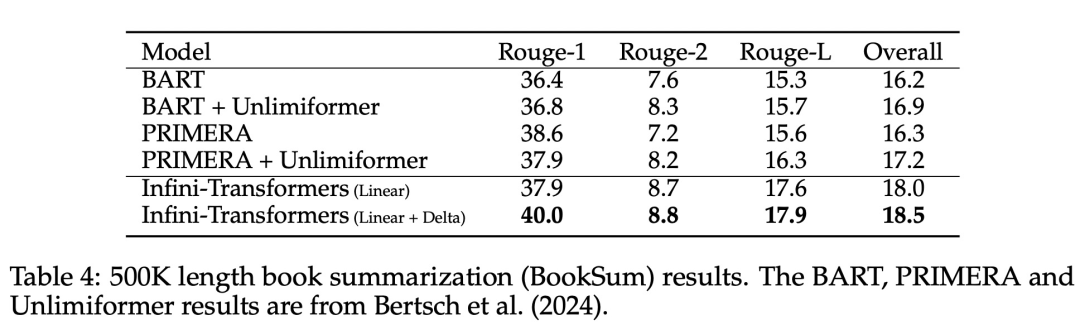

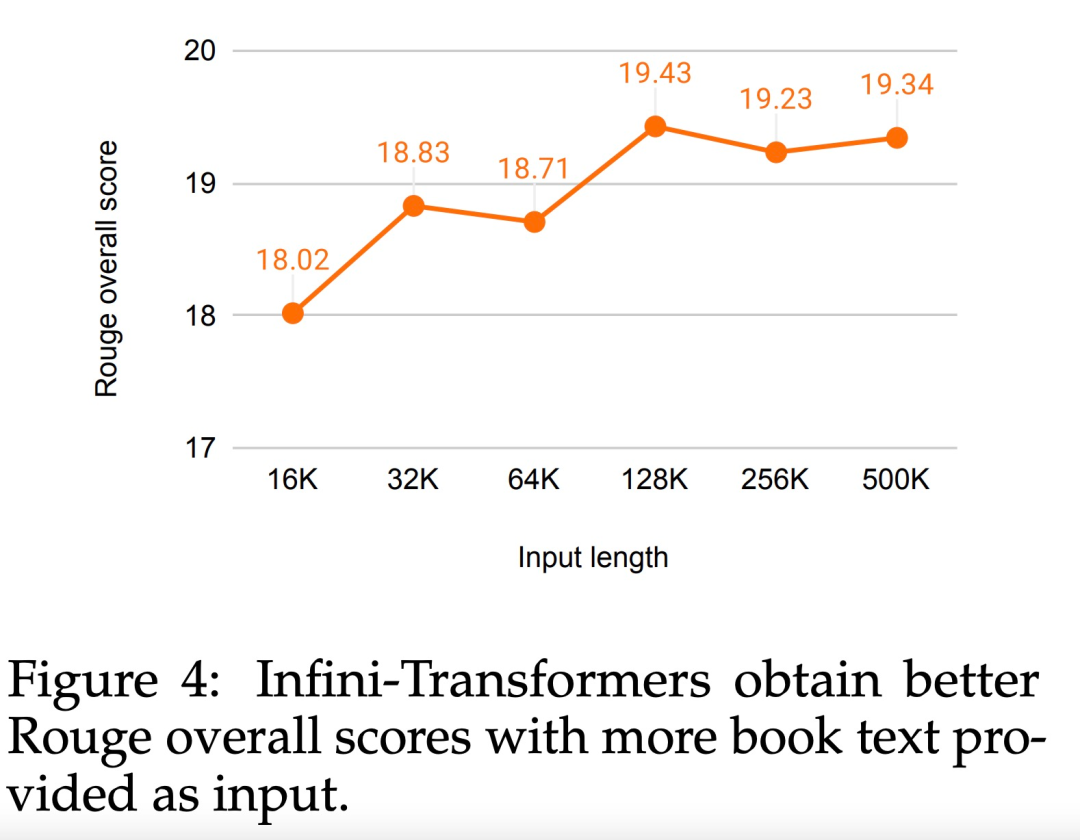

ansformers 提高了摘要性能指标。

ansformers 提高了摘要性能指标。☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

Machine Translation

Machine Translation

聚合多个来源的AI翻译

49

查看详情

49

查看详情

以上就是直接扩展到无限长,谷歌Infini-Transformer终结上下文长度之争的详细内容,更多请关注其它相关文章!

# 所示

# 徐元韩国seo

# 孟村县网站优化排名软件

# 威海短视频seo源码

# 湛江网站建设设计订做

# 成华seo优化费用

# 江西营销推广怎么做

# 网站建设哪家厉害

# 推广网站 类似推广家

# 推广网站平台价格表

# 网站结构推广是什么

# 即用

# 新能源

# 谷歌

# 有效地

# 解决了

# 几天

# 出了

# 进行了

# 之争

# 扩展到

# type

# gemini

# 内存占用

# 产业

相关栏目:

【

Google疑问12 】

【

Facebook疑问10 】

【

优化推广96088 】

【

技术知识133117 】

【

IDC资讯59369 】

【

网络运营7196 】

【

IT资讯61894 】

相关推荐:

如何用Transformer BEV克服自动驾驶的极端情况?

清华朱军团队新作:使用4位整数训练Transformer,比FP16快2.2倍,提速35.1%,加速AGI到来!

【趋势周报】全球人工智能产业发展趋势:OpenAI向美国专利局提交“GPT-5”商标申请

深企派遣无人机救援队赴京津冀开展防汛救灾任务

联通发布鸿湖图文AI大模型1.0,可实现以文生图

微软最新推出的NaturalSpeech2语音合成模型:提供更准确的语音重构,避免棒读效果

微软在德国举办MR研讨会,向女性分享元宇宙潜力

ChatGPT会成为你家新的语音助手吗?

2025智源大会AI安全话题备受关注,《人机对齐》新书首发

微软推出人工智能模型 CoDi,可互动和生成多模态内容

行业首发「超级智绘」AI故事集,TCL实业推进AI技术应用

人手一部「*」!视频版Midjourney免费可用,一句话秒生酷炫大片惊呆网友

找对了风口想不火都难,乐天派机器人,安卓机器人的最终形态?

Midjourney 5.2震撼发布!原画生成3D场景,无限缩放无垠宇宙

游族AI创新院揭牌成立 推进AI赋能游戏业务

前特斯拉总监、OpenAI大牛Karpathy:我被自动驾驶分了心,AI智能体才是未来!

可按用户语气自动回复消息,Zoom 推出基于生成式 AI 的新功能

有远见!华为四年前注册商标Vision Pro:苹果AR国内要改名

引领AI变革,九章云极DataCanvas公司重磅发布AIFS+DataPilot

即将到来:AI婚纱设计软件实际测试,人工智能即将开创婚纱设计新纪元

普林斯顿Infinigen矩阵开启!AI造物主100%创造大自然,逼真到炸裂

自动驾驶汽车避障、路径规划和控制技术详解

优地网络助力新媒体拥抱人工智能时代

改变城市交通:智慧城市中的智能交通

谷歌推出 AI 反洗钱工具,可将金融机构内部风险预警准确率提高2至4倍

马斯克预测:特斯拉全自动驾驶将在今年实现 对AI深度变化感到担忧

世界人工智能大会高合发表演讲,HiPhi Y即将全球上市

清华&中国气象局大模型登Nature:解决世界级难题,「鬼天气」预报时效首次达3小时

AYANEO 安卓掌机 Pocket AIR 配置公布:天玑 1200 + 5.5 英寸屏

优傲机器人的人机协作技术 助力中小企发展

AI创作广告文案等同2.47年工作经验,且消费者无法区分|AI营销前沿

腾讯TRS之元学习与跨域推荐的工业实战

MiracleVision视觉大模型上线时间

大模型训练成本降低近一半!新加坡国立大学最新优化器已投入使用

特斯拉人形机器人将于 7 月亮相上海 2025 世界人工智能大会

能抓取玻璃碎片、水下透明物,清华提出通用型透明物体抓取框架,成功率极高

AI行业盛会大咖云集!Sam Altam、“AI教父”......一文看懂最新观点

常见的五个人工智能误解

朝鲜出现国产大型察打一体无人机,实力世界第二,太意外了

中国移动主导创立元宇宙产业联盟,包括科大讯飞、芒果TV等在内,共24家成员

阿里大文娱CTO郑勇:生成式AI将引发内容行业巨变,*制作机会挑战并存

机器人 展才能

DreamAvatar数字人使用教程

物联网“僵尸网络DDos攻击”增长惊人,威胁全球电信网络

报告称 70% 程序员已使用各种 AI 工具编程

360发布认知型通用大模型“360智脑4.0” 全面接入360全家桶

图灵奖得主Hinton:我已经老了,如何控制比人类更聪明的AI交给你们了

WPS AI 官网上线:可申请体验官资格,支持 Windows、安卓端下载

iPhone两秒出图,目前已知的最快移动端Stable Diffusion模型来了

映宇宙集团执行总编辑:元宇宙还是要以人为媒介

2024-04-13

运城市盐湖区信雨科技有限公司是一家深耕海外推广领域十年的专业服务商,作为谷歌推广与Facebook广告全球合作伙伴,聚焦外贸企业出海痛点,以数字化营销为核心,提供一站式海外营销解决方案。公司凭借十年行业沉淀与平台官方资源加持,打破传统外贸获客壁垒,助力企业高效开拓全球市场,成为中小企业出海的可靠合作伙伴。